国盛计算机:英伟达GTC大会要点解读

- 最新资讯

- 2024-03-20

- 50

炒股就看金麒麟分析师研报,权威,专业,及时,全面,助您挖掘潜力主题机会!

【国盛计算机】英伟达GTC大会要点解读

作者:刘高畅(金麒麟分析师)

来源:国盛计算机畅想

核心观点

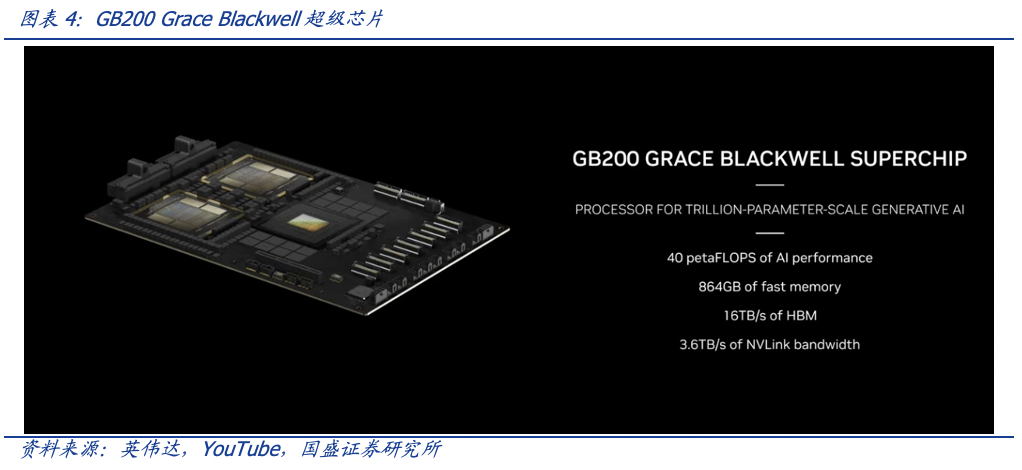

新一代Blackwell架构、超级芯片GB200发布,模型训练时长、功耗效率表现提高数倍。当地时间2024年3月18日,黄仁勋发表主题演讲《见证AI的变革时刻》,正式拉开2024年GTC大会的序幕。英伟达推出全新Blackwell架构GPU。1)Blackwell用于数据中心,针对当前火爆的AI大模型优化,训练、推理性能和能效均大幅提升,与Grace CPU、新一代网络芯片等产品一起,面向生成式AI共同组成完整解决方案。黄仁勋还特意称,Blackwell不只是芯片,而是一个全新的平台。2)基于Blackwell的处理器,B200为人工智能公司提供了巨大的性能升级,其AI性能为每秒20千万亿次浮点运算,而此前基于Hopper架构的最强的H100为每秒4千万亿次浮点运算,约是其5倍。如果要用Hopper训练一个拥有1.8万亿参数的GPT模型,可能需要8000个GPU,并消耗15兆瓦的电力。如果使用Blackwell来训练,只需要2000个GPU,同样的90天,但功耗降低至约四分之一,仅需4兆瓦的电力。2)新一代超级芯片GB200在拥有1750亿参数的GPT-3大模型基准测试中,性能是H100的7倍,训练速度是H100的4倍。此外,GB200是NVIDIA GB200 NVL72的关键组件。GB200 NVL72作为单个GPU运行,具有1.4 exaflops的AI性能和30TB的快速内存,用于LLM推理工作负载,并将成本和能源消耗降低多达25倍。

生成式AI微服务(NIM)发布,模型部署时间从几周缩减到几分钟。1)NIM是一套优化的云原生微服务,旨在缩短上市时间并简化在任何地方部署生成式AI模型的过程,包括云、数据中心和GPU加速的工作站。它通过使用行业标准API,抽象了AI模型开发和为生产打包的复杂性,扩大了开发者群体,将部署时间从几周缩短到几分钟。2)作为NVIDIA AI企业版的一部分,NIM以每年每GPU 4500美元、或云端每小时每GPU 1美元的价格,为开发AI驱动的企业应用和在生产中部署AI模型提供了一条简化的路径。3)GTC大会上,英伟达新发布了数十种NIM,企业可以使用这些微服务在自己的平台上创建和部署定制应用程序,同时完全拥有并控制其知识产权。黄仁勋发言称,现有的企业平台拥有可以转化为生成式AI***的数据宝藏;这些与英伟达的合作伙伴生态系统共同创建的容器化AI微服务是每个行业的企业成为AI公司的基石。

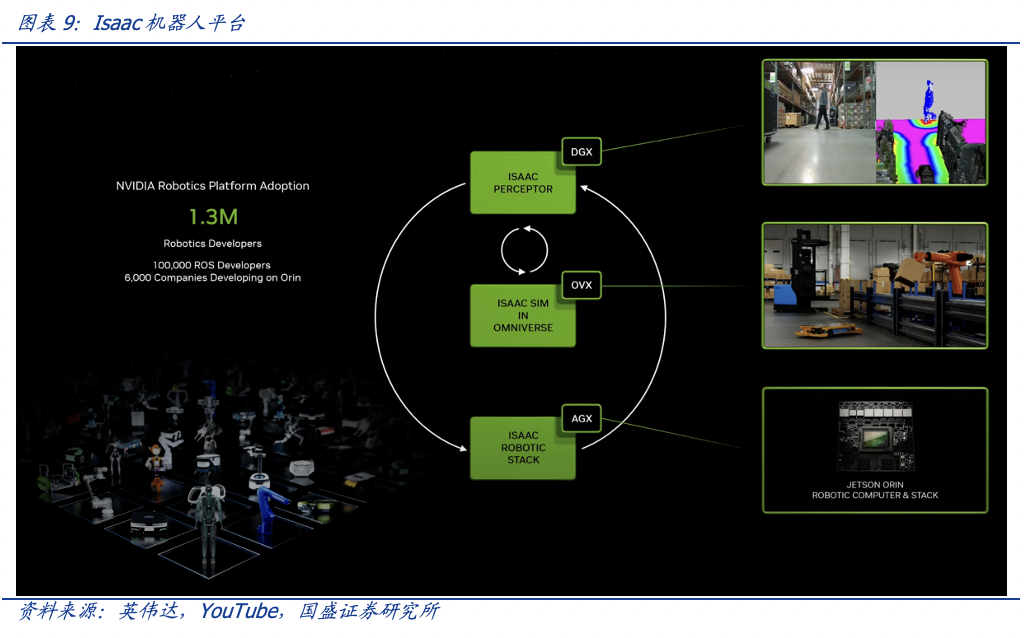

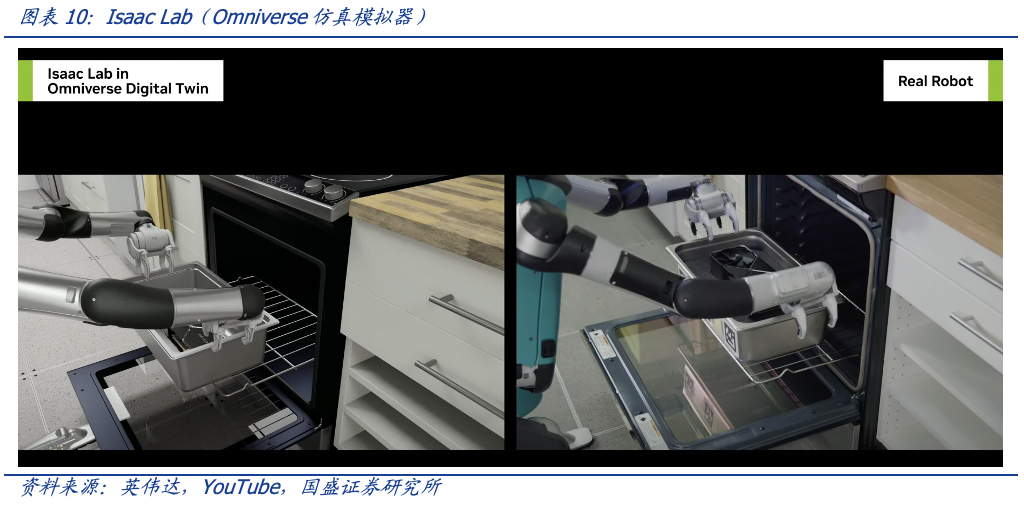

GR00T基础模型、Isaac机器人平台重大更新。1)在GTC大会上,英伟达宣布Project GR00T启动。这是一个通用的人形机器人基础模型,旨在推动其在机器人技术和具体化人工智能方面的突破。由GR00T驱动的机器人将被设计为理解自然语言并通过观察人类行动来模仿动作,包括快速学习协调、灵巧等技能,以便在现实世界中导航、适应和互动等。在GTC主题演讲中,黄仁勋展示了几种这样的机器人完成各种任务。2)Isaac机器人平台也进行了重大升级,包括生成式AI基础模型以及用于仿真和AI工作流程基础设施的工具。新的Isaac Lab是一个基于Isaac Sim构建的GPU加速、轻量级、性能优化的应用,专门用于运行成千上万的并行仿真,以进行机器人学习。

Blackwell助力DRIVE Thor平台定义自动驾驶,与多家中国车企展开合作。1)DRIVE Thor是英伟达为生成式AI应用设计的车载计算平台。随着Blackwell架构的推出,DRIVE Thor将与Blackwell架构整合,预计最早在明年的生产车辆中使用。2)GTC大会上,英伟达宣布与多家中国车企加强基于DRIVE Thor平台的合作,包括比亚迪、小鹏汽车、以及广汽埃安旗下的Hyper品牌。在此之前,理想汽车和吉利旗下的极氪汽车均宣布将***用英伟达的DriveThor技术。

投资标的:

算力侧:中科曙光、浪潮信息、海光信息、利通电子、高新发展、中际旭创、新易盛、工业富联、寒武纪、神州数码、恒为科技、软通动力、润建股份、万马科技、云赛智联、拓维信息、烽火通信等。

自动驾驶:江淮汽车、赛力斯、长安汽车、北汽蓝谷、德赛西威、中科创达、华依科技、万马科技、阿尔特、菱电电控、经纬恒润、东风汽车、光庭信息等。

机器人:三花智控、鸣志电器、拓普集团、绿的谐波。

AI相关:金山办公、大华股份、海康威视、昆仑万维、科大讯飞、拓尔思、润达医疗、中广天泽、漫步者、紫天科技(***)、万兴科技。

风险提示:技术迭代不及预期、经济下行超预期、行业竞争加剧。

报告正文

01

新一代Blackwell架构、超级芯片GB200发布

当地时间2024年3月18日,黄仁勋发表主题演讲《见证AI的变革时刻》,正式拉开2024年GTC大会的序幕。在两个小时的演讲中,黄仁勋围绕五大板块,介绍了英伟达的最新研发进展:新的产业发展、Blackwell平台、创新软件NIMs、AI平台NEMO和AI工坊(AI foundry)服务,以及仿真平台Omniverse和适用于自主移动机器人的Isaac Robotics平台。

时隔两年推出全新Blackwell架构GPU。新GPU架构Blackwell得名于美国数学家D***id Harold Blackwell。Blackwell用于数据中心,针对当前火爆的AI大模型优化,训练、推理性能和能效均大幅提升,与Grace CPU、新一代网络芯片等产品一起,面向生成式AI共同组成完整解决方案。黄仁勋还特意称,Blackwell不只是芯片,而是一个全新的平台。

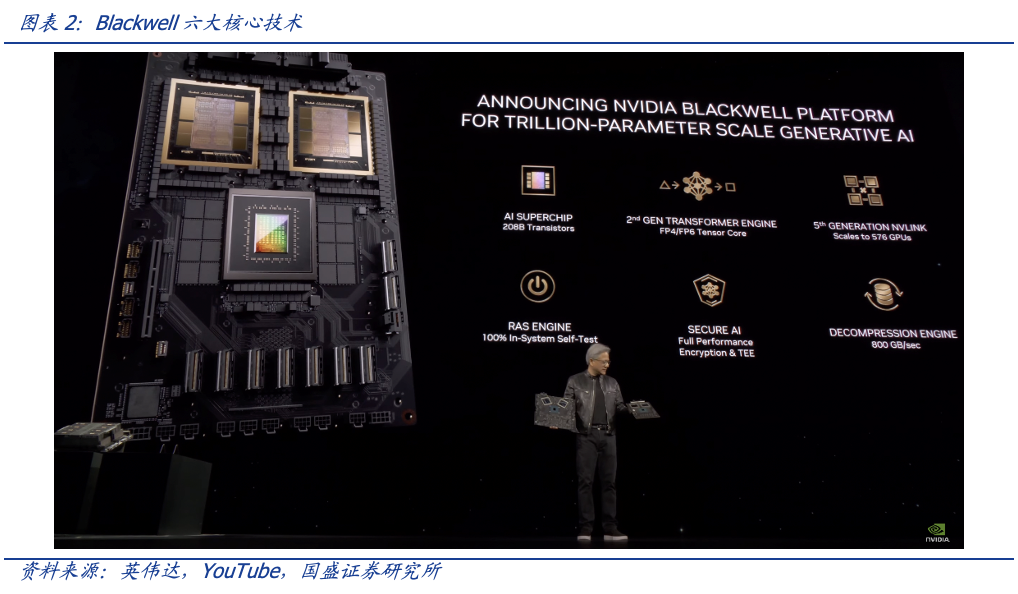

Blackwell拥有六项革命性技术,共同支持AI训练和实时LLM推理,模型可扩展至10万亿个参数:

“世界上最强大的芯片”:搭载2080亿个晶体管,Blackwell架构GPU***用定制的4NP TSMC工艺制造,两个视网膜***GPU芯片通过10 TB/秒的芯片间连接链接成一个统一的GPU。

第二代Transformer引擎:通过新的微张量扩展支持和NVIDIA集成的高级动态范围管理算法,加入到NVIDIA TensorRT™-LLM和NeMo Megatron框架中,Blackwell将支持双倍的计算和模型大小,具备新的4位浮点AI推理能力。

第五代NVLink:为了加速对多万亿参数和混合专家模型的性能,NVIDIA NVLink的最新迭代提供了前所未有的每哥GPU1.8TB/s的双向吞吐量,确保了最复杂的LLMs间高达576个GPU的无缝高速通信。

RAS引擎:Blackwell驱动的GPU包括一个专用于可靠性、可用性和服务能力的引擎。此外,Blackwell架构在芯片级别增加了利用基于AI的预防性维护能力,以运行诊断和预测可靠性问题。这最大化了系统运行时间,提高了大规模AI部署的弹性,使其能够无中断运行数周甚至数月,并降低了运营成本。

安全AI:先进的保密计算能力在不影响性能的情况下保护AI模型和客户数据,支持新的原生接口加密协议,这对于像医疗保健和金融服务这样对隐私敏感的行业至关重要。

解压缩引擎:一个专用的解压缩引擎支持最新格式,加速数据库查询以提供数据分析和数据科学中的最高性能。在未来几年,公司每年将在数据处理上花费数百亿美元,这将越来越多地通过GPU加速。

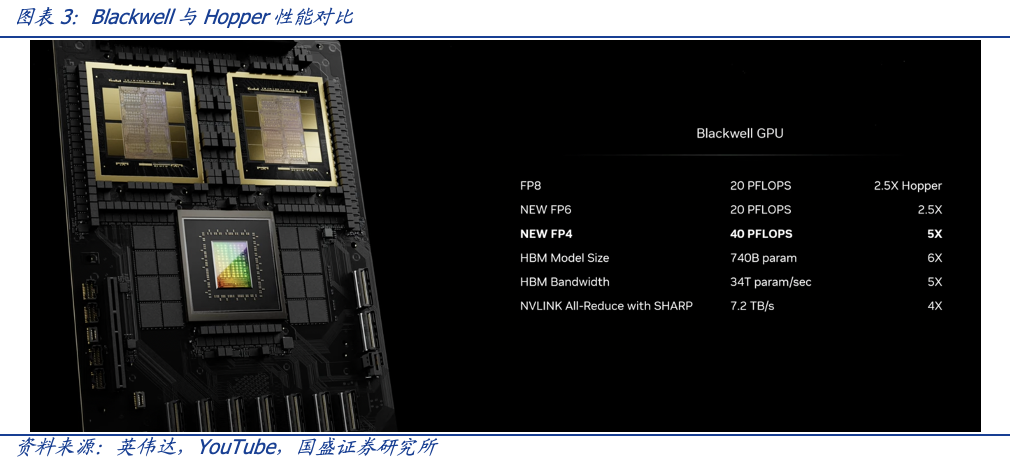

Blackwell vs. Hopper:5倍AI性能,4倍片上存储,功耗显著降低至四分之一。基于Blackwell的处理器,B200为人工智能公司提供了巨大的性能升级,其AI性能为每秒20千万亿次浮点运算,而此前基于Hopper架构的最强的H100为每秒4千万亿次浮点运算,约是其5倍。根据黄仁勋主题演讲,如果要用Hopper训练一个拥有1.8万亿参数的GPT模型,可能需要8000个GPU,并消耗15兆瓦的电力。如果使用Blackwell来训练,只需要2000个GPU,同样的90天,但仅需4兆瓦的电力。

新一代超级芯片GB200。本次GTC大会上,随着Blackwell架构GPU发布,英伟达顺势推出了“Grace Blackwell”GB200超级芯片。

从架构上来看,GB200通过900GB/s的超低功耗NVLink将两个Blackwell B20连接到一个Grace CPU。

为了获得最高的AI性能,GB200驱动的系统可以与今天同样宣布的NVIDIA Quantum-X800 InfiniBand和Spectrum™-X800以太网平台连接,这些平台提供高达800Gb/s的高级网络速度。

在拥有1750亿参数的GPT-3大模型基准测试中,GB200的性能是H100的7倍,训练速度是H100的4倍。

GB200是NVIDIA GB200 NVL72的关键组件。1)GB200 NVL72是一个多节点、液冷、机架规模系统,专为最计算密集型的工作负载设计。2)从架构来看,NVL72组合了36个Grace Blackwell Superchips,其中包括72个Blackwell GPU和36个Grace CPU,通过第五代NVLink互连。此外,GB200 NVL72还包括NVIDIA BlueField-3数据处理单元,以实现云网络加速、可组合存储、零信任安全性和在超大规模AI云中的GPU计算弹性。3)从性能来看,GB200 NVL72作为单个GPU运行,具有1.4 exaflops的AI性能和30TB的快速内存,并且是最新DGX SuperPOD的构建模块。GB200 NVL72提供的性能提升高达与相同数量的NVIDIA H100 Tensor Core GPU相比的30倍,用于LLM推理工作负载,并将成本和能源消耗降低多达25倍。

02

生成式AI微服务(NIM)发布

生成式AI的***用率显著增长,NIM带来部署AI模型的简化路径。1)OpenAI在2022年推出ChatGPT后,这项新技术在几个月内吸引了过亿用户,并促使几乎所有行业的开发激增。2)到了2023年,开发者开始使用Meta、Mistral、Stability等的API和开源社区模型进行概念验证。3)进入2024年,企业开始将重点转向全面的生产部署,这涉及将AI模型连接到现有的企业基础设施、优化系统延迟和吞吐量、日志记录、监控和安全等。这条通往生产的路径复杂且耗时——它需要特殊的技能、平台和流程,尤其是在大规模时。4)NVIDIA NIM,作为NVIDIA AI企业版的一部分,以每年每GPU 4500美元、或云端每小时每GPU 1美元的价格,为开发AI驱动的企业应用和在生产中部署AI模型提供了一条简化的路径。

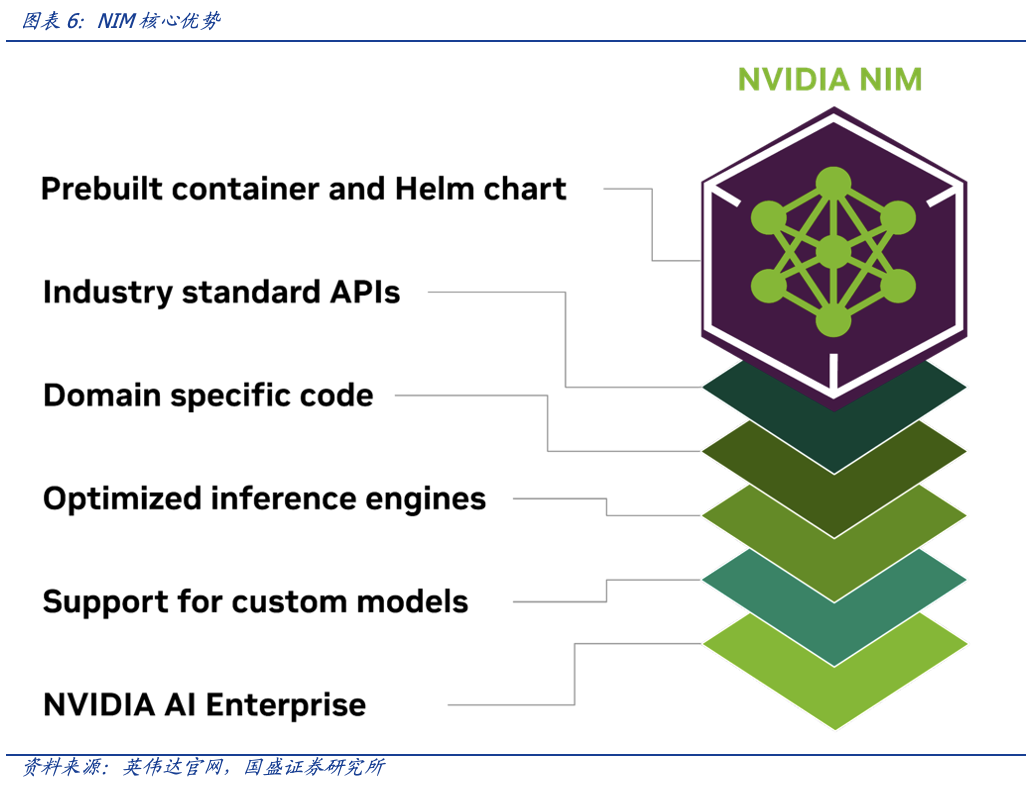

NIM是一套优化的云原生微服务,旨在缩短上市时间并简化在任何地方部署生成式AI模型的过程,包括云、数据中心和GPU加速的工作站。它通过使用行业标准API,抽象了AI模型开发和为生产打包的复杂性,扩大了开发者群体。NVIDIA NIM旨在桥接AI开发的复杂世界与企业环境的运营需求之间的差距,使得10-100倍更多的企业应用开发者能够为他们公司的AI转型做出贡献。

NIM的核心优势包括以下几点:

随处部署:NIM构建了可移植性和控制性,使得模型可以跨各种基础设施部署,从本地工作站到云端再到现场数据中心。这包括NVIDIA DGX、NVIDIA DGX Cloud、NVIDIA认证系统、NVIDIA RTX工作站和PC。

行业标准API开发:开发者可以通过遵循每个领域行业标准的API访问AI模型,简化AI应用的开发。这些API与生态系统内的标准部署流程兼容,使得开发者可以迅速更新他们的AI应用——通常只需三行代码。这种无缝集成和易用性促进了AI解决方案在企业环境中的快速部署和扩展。

领域特定模型:NIM还通过几个关键特性解决了对领域特定解决方案和优化性能的需求。它打包了领域特定的NVIDIA CUDA库和为各个领域量身定制的专用代码,如语言、语音、视频处理、医疗保健等。这种方法确保了应用对其特定用例的准确性和相关性。

在优化的推理引擎上运行:NIM利用针对每个模型和硬件设置优化的推理引擎,提供在加速基础设施上的最佳延迟和吞吐量。这降低了随着规模扩大运行推理工作负载的成本,并改善了最终用户体验。除了支持优化的社区模型外,开发者可以通过与专有数据源对齐和微调模型来实现更高的准确性和性能,这些数据源永远不会离开他们的数据中心边界。

支持企业级AI:作为NVIDIA AI企业版的一部分,NIM建立在企业级基础容器上,通过特性分支、严格验证、带服务级协议的企业支持以及常规安全更新来为企业AI软件提供坚实的基础。

NIM支持多行业模型,部署时间从几周缩短到几分钟。1)NIM支持许多AI模型,如社区模型、NVIDIA AI基础模型和NVIDIA合作伙伴提供的自定义AI模型,支持多个领域的AI用例。这包括大型语言模型(LLM)、视觉语言模型(VLM)以及语音、图像、***、3D、药物发现、医学成像等模型。2)NIM微服务通过打包算法、系统和运行时优化并添加行业标准API简化了AI模型部署流程。这使得开发者可以将NIM集成到他们现有的应用和基础设施中,而无需广泛的定制化或专业知识。由推理软件驱动的预建容器使开发者能够将部署时间从几周缩短到几分钟。

数十种企业级生成式AI微服务发布。GTC大会上,英伟达新发布了数十种企业级生成式AI微服务(NIM),企业可以使用这些微服务在自己的平台上创建和部署定制应用程序,同时完全拥有并控制其知识产权。黄仁勋发言称,现有的企业平台拥有可以转化为生成式AI***的数据宝藏;这些与英伟达的合作伙伴生态系统共同创建的容器化AI微服务是每个行业的企业成为AI公司的基石。

03

GR00T基础模型、Isaac机器人平台重大更新

黄仁勋在主题演讲上多次发言强调,“所有可移动的东西将变得机器化(everything that moves will be robotic)。”其中,汽车工业将会成为重要的组成部分。英伟达的计算机已经被应用在汽车、卡车、送货机器人和自动驾驶出租车中。全球最大的自动驾驶车辆公司比亚迪已经选择了英伟达的下一代计算机作为其自动驾驶车辆的核心,基于DRIVE Thor平台构建其下一代电动车。

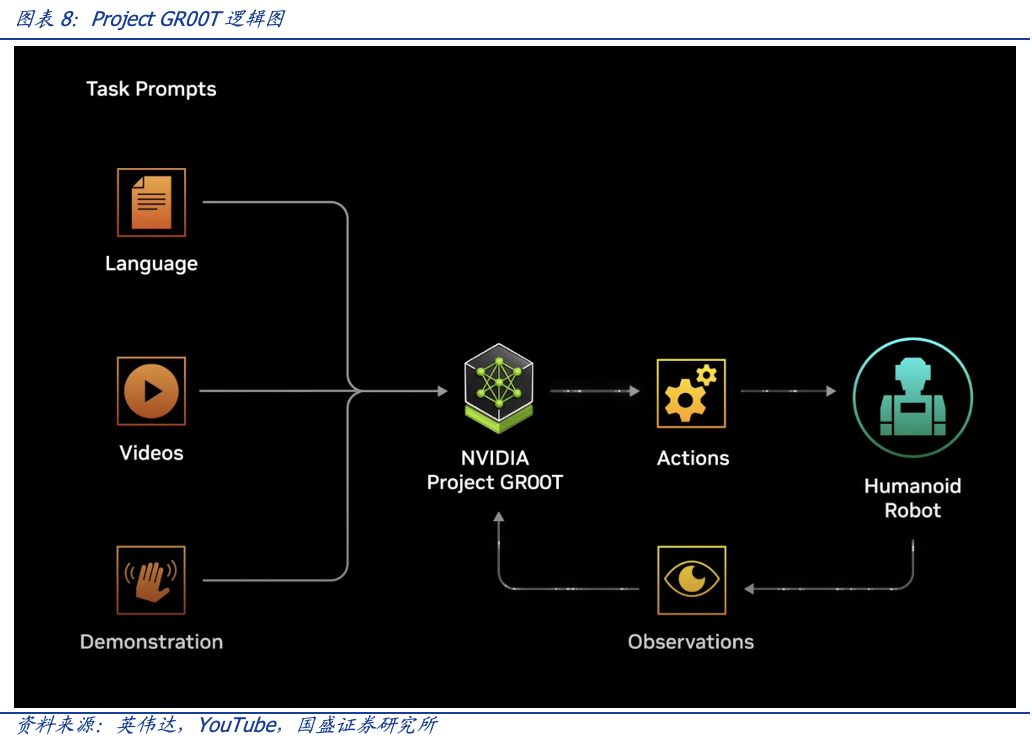

人形机器人Project GR00T启动。在GTC大会上,英伟达宣布Project GR00T启动。这是一个通用的人形机器人基础模型,旨在推动其在机器人技术和具体化人工智能方面的突破。由GR00T驱动的机器人将被设计为理解自然语言并通过观察人类行动来模仿动作,包括快速学习协调、灵巧等技能,以便在现实世界中导航、适应和互动等。在GTC主题演讲中,黄仁勋展示了几种这样的机器人完成各种任务。

作为Project GR00T的一部分,计算机Jetson Thor同步推出。专为人形机器人设计的Jetson Thor是一款新的计算平台,能够执行复杂任务,并与人类和机器安全、自然地互动。它***用了为性能、功耗和尺寸优化的模块化架构。具体来看,Thor包含基于NVIDIA Blackwell架构的下一代GPU,配备了Transformer引擎,提供800TFLOPS的8位浮点AI性能,用于运行如GR00T这样的多模态生成式AI模型。凭借集成的功能安全处理器、高性能CPU集群和100GB的以太网带宽,显著简化了设计和集成工作。

Isaac机器人平台也进行了重大升级,包括生成式AI基础模型以及用于仿真和AI工作流程基础设施的工具。1)GR00T利用的Isaac工具能够为任何环境中的任何机器人实体创建新的基础模型。这些工具包括用于强化学习的Isaac Lab和计算编排服务OSMO。2)具体化AI模型需要大量的真实和合成数据。新的Isaac Lab是一个基于Isaac Sim构建的GPU加速、轻量级、性能优化的应用,专门用于运行成千上万的并行仿真,以进行机器人学习。

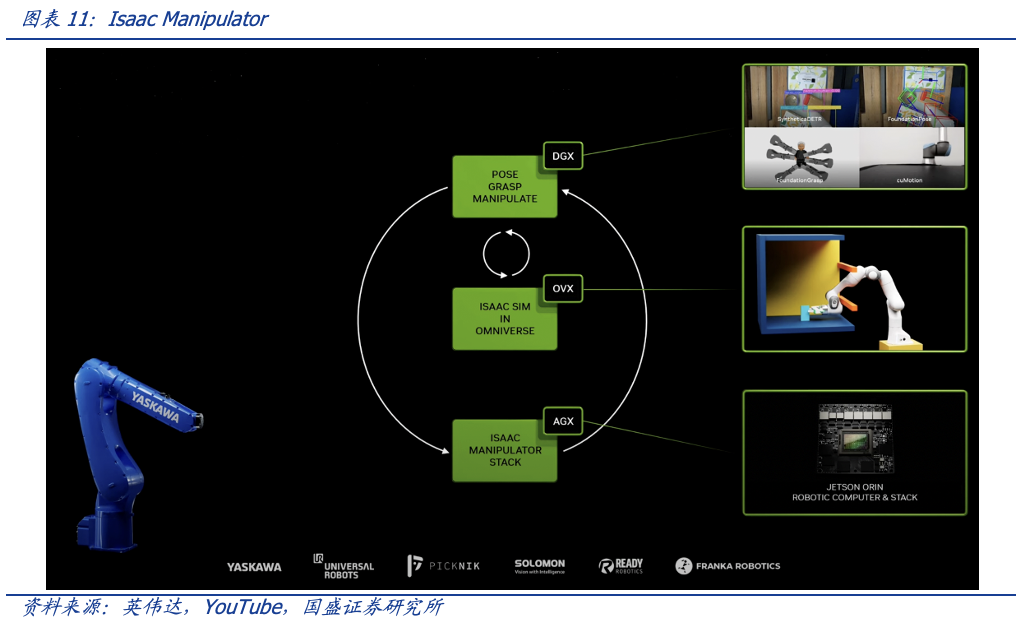

会上,还宣布了一系列机器人预训练模型、库和参考硬件的***,包括Isaac Manipulator和Isaac Perceptor。新的Isaac平台能力预计将在下一个季度可用。

Isaac Manipulator:为机器人手臂提供了最先进的灵巧度和模块化AI能力,包含了丰富的基础模型和GPU加速库。它在路径规划中提供高达80倍的速度提升,并且提高了效率和吞吐量,使开发者能够自动化更多的新机器人任务。早期生态系统合作伙伴包括Yaskawa、Universal Robots、PickNik Robotics、Solomon、READY Robotics和Franka Robotics。

Isaac Perceptor:提供了多摄像头、3D环绕视觉能力,这在制造和履行操作中***用的自主移动机器人中越来越多地被使用,以提高效率和工人安全,同时减少错误率和成本。早期***用者包括ArcBest、BYD和KION集团。

04

Blackwell助力DRIVE Thor定义自动驾驶

DRIVE Thor是一款为生成式AI应用设计的车载计算平台。由DRIVE Orin迭代而来,DRIVE Thor能够在一个集中化平台上实现驾驶舱的丰富功能,以及安全可靠的高度自动化和自动驾驶。随着专为LLM和生成式AI工作负载而设计的Blackwell架构的推出,DRIVE Thor将与Blackwell架构整合,预计最早在明年的生产车辆中使用。

英伟达汽车业务副总裁吴新宙在GTC大会上表示,加速计算带来了包括生成式AI在内的变革性突破,而这正在重新定义自动驾驶与全球交通运输行业。DRIVE Orin依旧是当下智能车型的AI汽车计算机首选,但现在越来越多的领先车企已经开始将新一代的DRIVE Thor放进了他们对下一代AI车辆的规划中。

在GTC大会上,几家电车制造商宣布将基于生成式AI平台DRIVE Thor构建下一代车型。在此之前,理想汽车和吉利旗下的极氪汽车已经宣布将在DRIVE Thor上构建其未来的车辆规划。

比亚迪:全球最大的电动车制造商,正在将其与英伟达的持续合作从汽车扩展到云端。除了基于DRIVE Thor构建其下一代电动车,比亚迪还***使用NVIDIA的AI基础设施进行基于云的AI开发和训练技术,以及使用NVIDIA Isaac和NVIDIA Omniverse平台开发虚拟工厂规划和零售配置器的工具和应用程序。

Hyper:广汽埃安旗下的高端豪华品牌,宣布它已选择DRIVE Thor支持其下一代电动车。该车型将于2025年开始生产,具备L4自动驾驶。Hyper目前正在其旗舰车型Hyper GT上使用DRIVE Orin,该车型具有L2+自动驾驶能力。

小鹏汽车:宣布将使用DRIVE Thor平台作为其下一代电车的AI大脑。DRIVE Thor将为小鹏的XNGP AI***驾驶系统提供动力,实现自动驾驶和泊车、驾驶员乘客监控,以及其他一系列功能。

DRIVE Thor为长途卡车、配送车辆、机器人出租车提供动力。除了乘用车外,DRIVE Thor满足了其他领域的多样化需求,这些领域中高性能计算和AI对于确保安全、安全的驾驶操作至关重要,包括卡车运输、机器人出租车、货物配送车辆等。

Nuro:为商用车和乘用车开发L4自动驾驶技术的公司,已选择DRIVE Thor来为Nuro Driver提供动力。Nuro Driver是一个集成的自动驾驶系统,由Nuro的专有的AI软件和传感器组成,与英伟达的汽车级计算和网络硬件配对。该系统将在今年晚些时候开始测试。

Plus:一家全球自动驾驶软件解决方案提供商,宣布其未来几代L4解决方案SuperDrive将运行在符合安全标准的汽车级DRIVE Thor中央计算机上。Plus将利用DRIVE Thor的计算性能来检测卡车周围的世界并做出安全的驾驶决策。

Waabi:正在开发自动驾驶AI的公司,正在利用DRIVE Thor推出市场上首个由生成式AI驱动的自动驾驶卡车解决方案。该公司***在其Waabi Driver中整合DRIVE Thor,以大规模提供安全可靠的自动驾驶卡车。

WeRide:与一级合作伙伴联想汽车计算合作,正在基于DRIVE Thor创建几个面向商业应用的L4自动驾驶解决方案。这一解决方案将集成在联想的首款自动驾驶域控制器AD1中,将用于大量以城市为中心的案例,并专注于功能安全、冗余安全设计、融合和可扩展性。

05

投资建议

算力侧:中科曙光、浪潮信息、海光信息、利通电子、高新发展、中际旭创、新易盛、工业富联、寒武纪、神州数码、恒为科技、软通动力、润建股份、万马科技、云赛智联、拓维信息、烽火通信等

自动驾驶:江淮汽车、赛力斯、长安汽车、北汽蓝谷、德赛西威、中科创达、华依科技、万马科技、阿尔特、菱电电控、经纬恒润、东风汽车、光庭信息等

机器人:三花智控、鸣志电器、拓普集团、绿的谐波

AI相关:金山办公、大华股份、海康威视、昆仑万维、科大讯飞、拓尔思、润达医疗、中广天泽、漫步者、紫天科技、万兴科技

06

风险提示

技术迭代不及预期风险:若技术迭代不及预期,则对产业链相关公司会造成一定不利影响。

经济下行超预期风险:若宏观经济景气度下行,固定资产投资额放缓,影响企业再投资意愿,从而影响消费者消费意愿和产业链生产意愿,对整个行业将会造成不利影响。

行业竞争加剧风险:若相关企业加快技术迭代和应用布局,整体行业竞争程度加剧,将会对目前行业内企业的增长产生威胁。

具体分析详见2024年03月20日发布的报告《英伟达GTC大会要点解读》

分析师 刘高畅 分析师执业编号S0680518090001

分析师 陈芷婧 分析师执业编号S0680523080001

特别声明:《证券期货投资者适当性管理办法》于2017年7月1日起正式实施。通过微信形式制作的本资料仅面向国盛证券客户中的专业投资者。请勿对本资料进行任何形式的转发。若您非国盛证券客户中的专业投资者,为保证服务质量、控制投资风险,请取消关注,请勿订阅、接受或使用本资料中的任何信息。因本订阅号难以设置访问权限,若给您造成不便,烦请谅解!感谢您给予的理解和配合。

重要声明:本订阅号是国盛证券计算机团队设立的。本订阅号不是国盛计算机团队研究报告的发布平台。本订阅号所载的信息仅面向专业投资机构,仅供在新媒体背景下研究观点的及时交流。本订阅号所载的信息均摘编自国盛证券研究所已经发布的研究报告或者系对已发布报告的后续解读,若因对报告的摘编而产生歧义,应以报告发布当日的完整内容为准。本资料仅代表报告发布当日的判断,相关的分析意见及推测可在不发出通知的情形下做出更改,读者参考时还须及时跟踪后续最新的研究进展。

本资料不构成对具体证券在具体价位、具体时点、具体市场表现的判断或投资建议,不能够等同于指导具体投资的操作性意见,普通的个人投资者若使用本资料,有可能会因缺乏解读服务而对报告中的关键***设、评级、目标价等内容产生理解上的歧义,进而造成投资损失。因此个人投资者还须寻求专业投资顾问的指导。本资料仅供参考之用,接收人不应单纯依靠本资料的信息而取代自身的独立判断,应自主作出投资决策并自行承担投资风险。

请在主题配置设置声明 [免责声明]本文来源于网络,不代表本站立场,如转载内容涉及版权等问题,请联系邮箱:83115484@qq.com,我们会予以删除相关文章,保证您的权利。转载请注明出处:http://www.0514hunyin.com/post/58956.html